(文/赵法彬)随着AI的快速发展,让混合IT环境中掀起了新一波智能化的浪潮。IDC研究发现,要想成功利用人工智能,企业需要对许多现有应用和数据环境进行现代化改造,消除现有系统和存储平台之间的障碍,提高基础架构的可持续性,并在云端、数据中心和边缘之间谨慎选择部署不同工作负载的位置。在5月6日至9日召开的2024红帽全球峰会上,AI也成为最重要的一个话题,红帽总裁兼CEO Matt Hicks通过网络与全球媒体沟通时认为,企业选择红帽,可以更好地利用AI。

企业AI需要构建一个坚实的混合云基础

在人工智能模型从实验阶段转向投产阶段的过程中,客户面临着诸多挑战,包括硬件成本增加、数据隐私问题以及在与基于SaaS的模型共享数据时缺乏信任。生成式人工智能(GenAI)领域的快速变化加剧了这些挑战,因此许多企业都在积极努力构建可靠的核心人工智能平台,使其能够在本地或云端运行。对红帽而言,这意味着人工智能平台必须具备灵活性,以支持企业在采用人工智能的过程中取得进展,并且适应需求和资源的变化。Matt Hicks表示,许多企业尝试过使用规模较小的模型进行微调和训练,但往往成效不佳。因此,他们转而使用“全知模型”——这些模型通常在公共云中运行,参数量非常巨大。尽管这些模型开箱即用能完成许多任务,但它们的运行和训练成本非常高。当企业受限于云环境时,有很多场景是难以应对的。Matt Hicks举例称:“例如,我会在我的笔记本电脑上运行模型以提高生产力,而我的数据从未离开过我的设备。这些模型无论用于编程还是写作,都能增强我的工作效率,但它们无法在云工作流中得到增强。”他表示,无论是在笔记本电脑、工厂边缘还是汽车中,混合功能对于充分发挥AI的潜力都是关键。“我们必须改进这些小型模型,使其更好地适应实际任务,这需要在特定用例上完成最后一段训练,这就是我们回归Instruct Lab的原因。仅仅发布一个有7亿、3亿或10亿参数的模型是不够的,我们需要使企业能够针对他们的具体应用场景,在笔记本电脑、边缘设备、汽车或数据中心训练这些模型。”

红帽的不同之处在于其对运行位置的核心灵活性。红帽致力于支持小型的开源模型进行混合部署。企业可以在公共云或自己的数据中心训练这些模型,并在边缘部署它们。此外,红帽的平台设计为支持所有主要GPU提供商,包括NVIDIA、AMD和Intel,这种能力类似于Linux早期,当时针对红帽企业版Linux编译的应用可以在不同的硬件平台之间移动。红帽旨在为企业今天和将来使用的硬件以及模型运行的位置提供灵活性,从公共云到边缘。

红帽发布的Granite代码模型在119种不同的语言上进行了训练,有望解决IT领域最大的挑战之一:维护领先地位。Matt Hicks表示,这些模型可以根据企业的需求进行调整,这是一个变革性的举措,不仅允许从笔记本电脑到服务器都可以运行的功能强大的小型开源模型,还可以根据企业特定的用例进行训练和优化。这可能会大大提升用户的使用体验,尤其对于已经开发了自己的语言或领域特定语言的公司而言。在许可方面,这个生态系统的可持续性至关重要。如果每个人都在开源数据上进行训练,但又没有遵守这些许可证,可能会削弱生态系统的可持续性。然而,他认为这个挑战并非不可克服:“通过了解企业进行训练的数据,并在推荐中提供透明度,我们可以确保合规性。这可能会重新引发对于诸如Apache、MIT或GPL等许可证的认识和重视,以及如何正确处理它们。红帽致力于帮助客户在处理这些方面时感到舒适和安全。”模型通常使用大量数据进行训练,而这些数据通常由个人创造并持有版权,他们经常会为这些内容附上开源软件许可证。当人工智能系统使用这些数据进行训练时,有时会以代码建议等方式重现部分内容供用户使用。负责任的做法意味着从管道的开始就保护创建者的权益,并遵守他们选择的许可条款,无论是归属原始代码还是确保根据GPL等许可证规定的再分发权,以保持内容的开源性。另一个关键点是理解训练模型所使用的数据,这意味着确保用户知道模型建议的来源。Matt Hicks说:“我们已经开始利用 Hansel Lightspeed 来显示建议的来源,并将继续发展这一功能。”

针对企业关心的开源安全问题,Matt Hicks告诉记者,人们对安全性和新攻击可能性的担忧很多,这些攻击可能会欺骗模型传递不当或非法内容。“为了解决这些问题,我们需要健全的安全框架,并随着新威胁的出现进行调整。这需要跨技术和组织的合作,我们正在与各种模型合作,如LLaMA、Mistral和Granite,以及像IBM和红帽这样的公司,共同创建一个共同的平台来应对这些挑战。特别是指令调整为提高我们对这些威胁的响应时间提供了重要的潜力。在安全威胁和防御之间的持续斗争中,培育社区参与至关重要。这确保了所有开源模型都受益,并且安全措施不仅限于少数专有模型。通过增进模型训练的透明度和对安全威胁的响应能力,我们可以显著提升人工智能的整体安全水平。我相信开源模型凭借众多参与者的优势能够产生更好的结果和更安全的软件。”

做好传统IT技术与人工智能的整合

能够运行一个已经构建好的模型是一回事,但更为强大的是能够通过训练模型来定制自己的解决方案,并在实践中加以应用。通常情况下,这意味着将模型部署为服务,我们也可以使用另一个术语来形容这一过程,叫做模型的“影响”。但是我们必须能够与之交互,调用它,向它提问,这实际上是我们今天应用程序的接口。

Matt Hicks表示这正是红帽谈论RHEL和RHEL AI,以及OpenShift和OpenShift AI的原因之一:“RHEL用于运行所有可以在Linux上运行的应用程序,而RHEL AI则用于运行你可以通过训练和定制的大型语言模型的AI部分。OpenShift用于管理可以在RHEL上以分布式方式跨集群运行的所有应用程序,而OpenShift AI则以相同的方式管理一系列模型,高效地分割训练、使用和提供服务。这些事情将有很多交叉点,因为人工智能并不是孤立存在的——它只是你的应用程序、你的员工、开发人员使用的一种工具。因此,我们将看到传统设置与人工智能应用程序之间产生许多交叉链接和整合。”

RHEL AI的主要目标是利用硬件加速,在未来几年内覆盖NVIDIA、AMD、Intel等各类硬件,进行模型的训练和运行。红帽现有的混合平台主要关注的是应用程序的生命周期,通常从Linux开始,然后转向OpenShift、中间件和运行时环境。相较而言,RHEL AI更专注于为大型语言模型创建业务安全、管理生命周期和提供可预测性,并使用户能够对其进行修改。由于大型向量模型的更新速度更快,因此它们的生命周期会更短。这是一个专为引入新类别硬件而设计的堆栈,类似于红帽推出RHEL时所做的工作,这次目标是支持大型语言模型,而不仅仅是传统的Python、Perl和PHP应用程序。

红帽是如何在传统和云原生平台以及对人工智能的需求之间保持平衡的呢?传统平台(如RHEL和OpenShift)专注于应用程序运行时,具有长寿命和稳定的二进制接口兼容性,而红帽的人工智能驱动型项目(如RHEL AI和OpenShift AI)则围绕大型语言模型和逐步将模型部署到生产环境中。虽然它们看起来截然不同,但所需的核心技能却是相似的。这种技能的无缝整合确保红帽能够有效地满足传统和人工智能应用的硬件需求。

Matt Hicks认为Linux将继续扮演至关重要的角色:“尽管我们使用Linux的方式正在演变,但支持大型语言模型操作(如训练和推理)的核心软件堆栈,例如PyTorch和Python堆栈,对Linux有着极大的依赖。Linux优化了这些软件的整合和性能,并作为GPU、CPU和新兴硬件类型之间的协调者。我们看到Linux的发展,例如基于图像或模式增强,以促进为AI应用程序优化的类似设备的能力。Linux使这些软件堆栈能够有效地运行,我认为在由人工智能主导的领域中,它仍将是我们技术基础设施的关键组成部分。”

“开源的优势之一就在于它不受地域或国家的限制。”谈到亚太地区的人工智能发展,Matt Hicks认为亚太地区在创新能力和技能方面与其他地区一样强大。他表示:“虽然目前在模型语言能力方面存在挑战,主要是因为英语内容在互联网上占主导地位,但我在过去一年中发现这些模型的显著发展以及训练的改进。相信随着我们将亚太地区的学术知识和创新与各国的本土语言相结合,这一差距将会缩小。”他预计这些进步将在一年内显现出来,之后亚太地区将像世界上许多其他地区一样在人工智能领域迅速发展。

在过去三十多年中,开源技术不仅推动了快速创新,还大幅降低了IT成本并降低了创新门槛。从21世纪初通过RHEL提供开放式企业Linux平台,到通过红帽OpenShift推动容器和Kubernetes成为开放式混合云和云原生计算的基础,红帽几乎一直引领着这一潮流。红帽在开放混合云中赋能人工智能/机器学习战略,支持人工智能工作负载在数据所在的地方运行,无论是在数据中心、多个公有云或边缘。除了支持工作负载外,红帽的人工智能愿景还将模型训练和调整引向同一方向,以更好地应对数据主权、合规和操作完整性等方面的限制。红帽的平台为这些工作负载提供跨环境的一致性,无论它们在何处运行,这对于顺利推进人工智能创新至关重要。

安森美推出面向工业、环境和医疗应用的下一代电化学传感器解决方案

2024-04-11

2024-03-04

2024-10-16

2024-08-29

ServiceNow、Hugging Face和 NVIDIA发布全新开放获取LLM,助力开发者运用生成式AI构建企业应用

2024-02-29

2023-09-27

2024-04-23

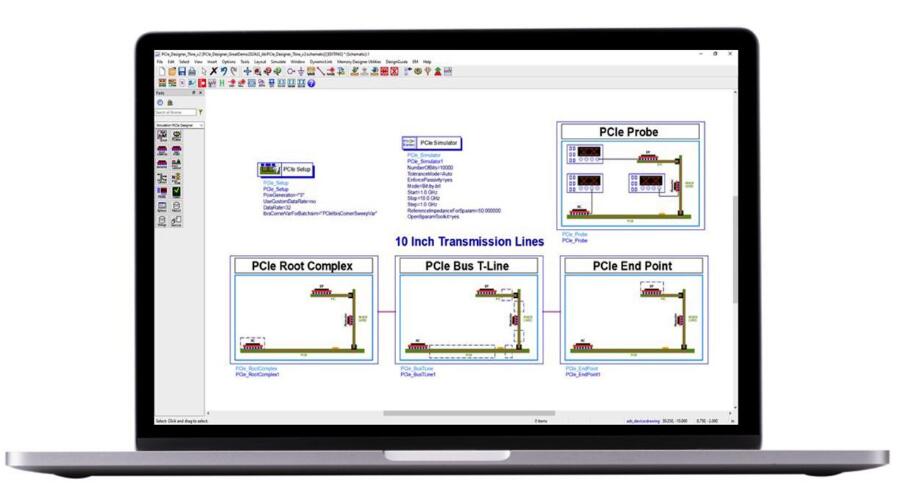

是德科技推出System Designer for PCIe®和Chiplet PHY Designer

2024-07-26

2024-02-22

欧洲专利局(European Patent Office)公布《2023年专利指数》

2024-04-12